Миграция из Snowflake в ClickHouse

В этом руководстве описывается процесс миграции данных из Snowflake в ClickHouse.

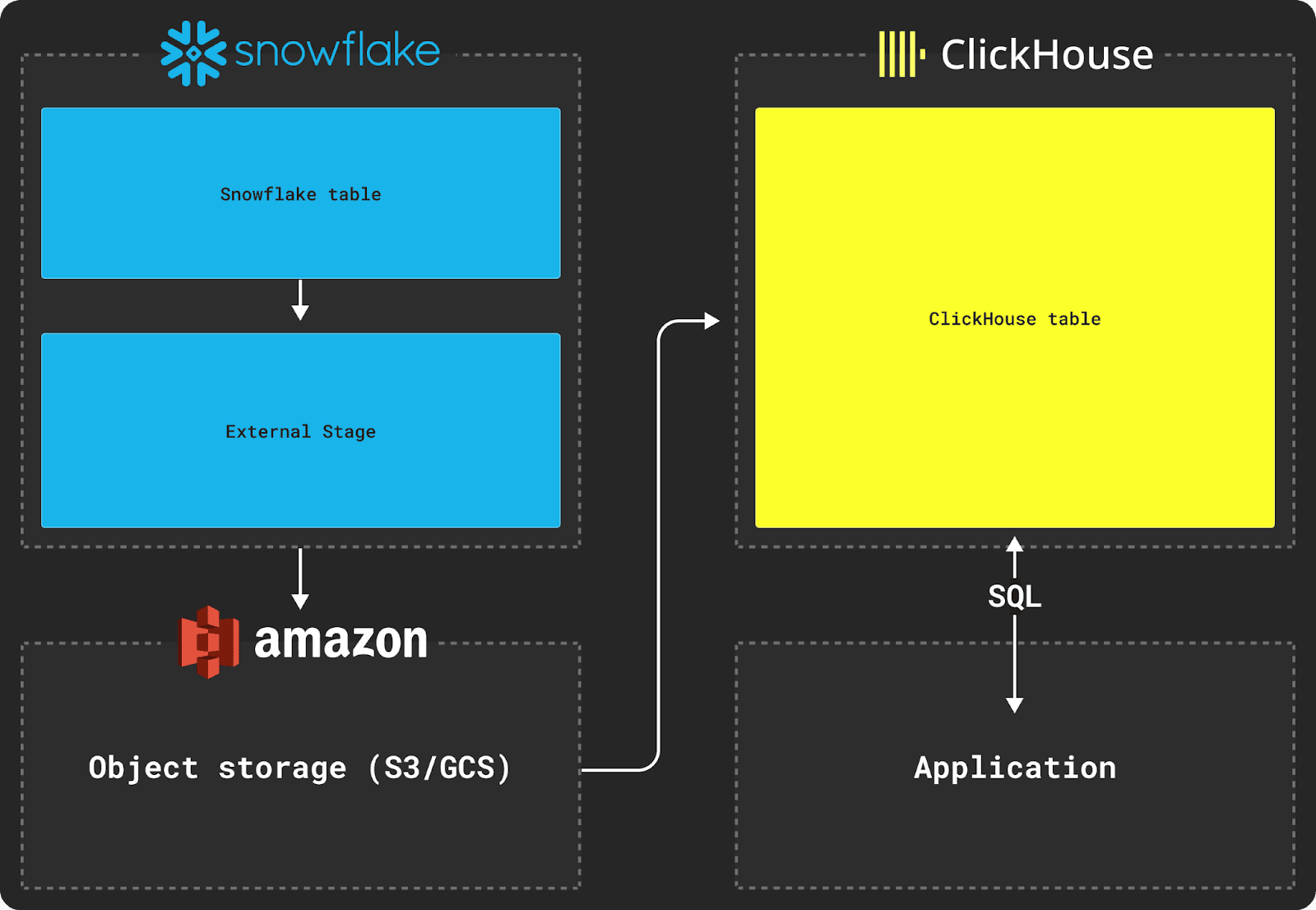

Для миграции данных из Snowflake в ClickHouse необходимо использовать объектное хранилище,

например S3, в качестве промежуточного хранилища. Процесс миграции также

предполагает использование команды COPY INTO в Snowflake и INSERT INTO SELECT

в ClickHouse.

Экспорт данных из Snowflake

Для экспорта данных из Snowflake необходимо использовать внешний stage (external stage), как показано на диаграмме выше.

Предположим, что мы хотим экспортировать таблицу Snowflake со следующей схемой:

Чтобы перенести данные этой таблицы в базу данных ClickHouse, сначала нужно скопировать их во внешний stage. При копировании данных мы рекомендуем использовать Parquet как промежуточный формат, поскольку он позволяет передавать информацию о типах, сохраняет точность, хорошо сжимается и нативно поддерживает вложенные структуры, типичные для аналитики.

В примере ниже мы создаём именованный формат файла в Snowflake для представления формата Parquet и требуемых параметров файлов. Затем указываем, какой bucket будет содержать наш скопированный набор данных. Наконец, копируем набор данных в этот bucket.

Для набора данных объемом около 5 ТБ с максимальным размером файла 150 МБ и при использовании виртуального склада Snowflake типа 2X-Large, расположенного в том же регионе AWS us-east-1, копирование данных в бакет S3 займет примерно 30 минут.

Импорт в ClickHouse

После того как данные размещены во временном объектном хранилище, функции ClickHouse, такие как табличная функция s3, можно использовать для вставки данных в таблицу, как показано ниже.

В этом примере используется табличная функция s3 для AWS S3, но табличную функцию gcs можно использовать для Google Cloud Storage, а табличную функцию azureBlobStorage — для Azure Blob Storage.

Предположим, что целевая схема таблицы имеет следующий вид:

Затем мы можем использовать команду INSERT INTO SELECT, чтобы загрузить данные из S3 в таблицу ClickHouse:

Столбцы VARIANT и OBJECT в исходной схеме таблицы Snowflake по умолчанию будут выводиться в виде строк JSON, поэтому при вставке в ClickHouse их необходимо явно приводить к нужному типу.

Вложенные структуры, такие как some_file, при выполнении операции COPY в Snowflake преобразуются в строки JSON. Импорт этих данных требует преобразования таких структур в тип Tuple при вставке в ClickHouse с использованием функции JSONExtract, как показано выше.

Проверка успешного экспорта данных

Чтобы проверить, что данные были корректно вставлены, выполните запрос SELECT к новой таблице: